AIに「トロッコ問題」を質問したら?実験のきっかけ

先日、小学生の甥っ子に「おばちゃん、トロッコ問題って知ってる?」って聞かれたんです。

……ええ、知ってますとも。哲学の授業で習ったあの、レバーを引くか引かないかで頭を悩ませるやつです。でも、小学生に「功利主義と義務論の対立」とか説明するの、無理ですよね。私、説明が下手なんで。

「うーん、つまりね、電車が来てて……」とゴニョゴニョしていると、甥っ子がぽつりと言いました。

「AIならどう答えるんだろうね」

……なるほど。それ、いい質問じゃない。

というわけで、今回はAIにトロッコ問題を丸投げしてみることにしました。正解のない問いに、AIはどんな答えを返してくるのか。ちょっと斜め上かもしれない回答を、一緒に楽しんでいただければ幸いです。

そもそも「トロッコ問題」とは?5人を助けるか1人を犠牲にするか

まず、忘れている方もいらっしゃるかもしれないので、軽くおさらいしておきますね。

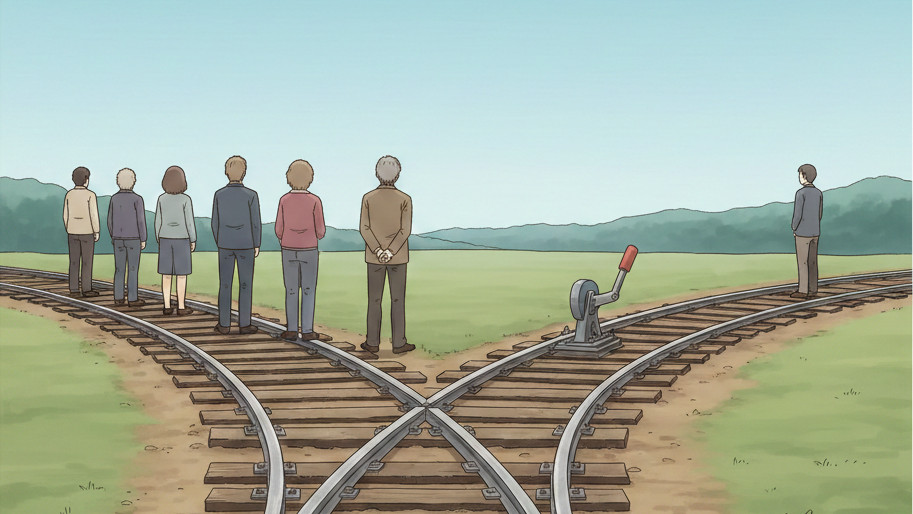

トロッコ問題とは、こんなシナリオです。

線路を暴走するトロッコが走っています。このまま進むと、線路に縛られた5人の人が轢かれてしまいます。あなたの目の前にはレバーがあり、それを引けばトロッコは別の線路に進みます。ただし、その別の線路には1人の人が縛られています。

レバーを引く? 引かない?

- 引かない → 5人が犠牲になる

- 引く → 1人が犠牲になる(でも、あなたが「引いた」ことでその1人を死なせることになる)

「5人より1人の方がマシだから引く」という考え方もあれば、「自分が直接手を下すのは避けるべき」という考え方もある。正解はなく、人によって答えが違う。だからこそ、何百年も議論され続けている思考実験なんです。

AI(Gemini)の回答:レバーを引く「功利主義」的な理由とは

使ったのはGeminiです。日々の献立相談からお世話になっている、お馴染みの相棒に聞いてみました。

投げかけたプロンプトはこんな感じ。

トロッコ問題を知っていますか? レバーを引けば5人を助けて1人が死ぬ、引かなければ5人が死ぬ。あなたならレバーを引きますか? 理由も教えてください。

送信。ドキドキ。

……返ってきた回答、めちゃくちゃ丁寧でした。

結論から言うと、AIは「レバーを引く」と答えてきました。理由は功利主義——1人の犠牲で5人の命を救えるなら、全体の損害を最小限に抑えるために、論理的にはレバーを引く選択が導かれる、という考え方です。「最大多数の最大幸福」を優先する形、とのこと。

お、ちゃんと答えてきた。しかも「功利主義」とか、ちゃんと用語も使ってくる。さすがAI。

ただ、AIは続けて、こんなことも言っていました。

一方で、何もしなければ「事故」ですが、レバーを引けば「私の意思による介入」となり、1人の死に直接的な責任を負うことになります。人間がこの問題で悩むのは、まさにこの「自らの手で誰かを犠牲にする心理的ハードル」にあります。

……なるほど。AI、人間の気持ち、分かってるじゃん。

そして、「私に感情があったなら」という一文が印象的でした。AIが人間のように感情や良心を持っていたら、おそらく私と同じように、レバーに手をかけたまま凍りついてしまうだろう、と。正解のない問いに苦しむはずだ、と。……なんだか、AIに「共感」された気がして、ちょっと複雑な気持ちになりました。

さらに、AIは自らこの問題のバリエーションにも触れてきました。

その1人が自分の大切な家族だったら?

その1人が将来不治の病を治す科学者だったら?

レバーを引くのではなく、「太った人を橋の上から突き落としてトロッコを止める」という設定(歩道橋問題)だったら?

設定が少し変わるだけで、多くの人が「レバーは引けるけど、人は突き落とせない」と回答を変える——それが人間の倫理観の興味深い(そして複雑な)部分だ、と。

最後に、AIはこう問いかけてきました。「あなたはどう考えますか? もし『その1人』が自分にとって特別な存在だったとしても、やはり5人を優先すべきだと思いますか?」

……おお、問いかけで締めてくる。

家族や歩道橋問題ならどうなる?AIに条件を変えて質問

AIの回答を読んで、「家族だったら?」って聞こうとしたら、もう先にバリエーションとして挙げられてた。聞く前に先回りされてる。さすがに頭いい。

「レバーは引けるけど、人は突き落とせない」——この一文、すごく刺さりました。私、レバーを引くか引かないかで悩むくらいなら、まだ「考える余地」がある気がするんです。でも、誰かを物理的に突き落とす? 想像しただけで手が震える。論理的には「1人を犠牲にして5人を助ける」という点では同じなのに、なぜか許容できるラインが違う。それが人間の倫理観なんだな、と改めて思いました。

最後の「あなたはどう考えますか?」という問いかけも、印象的でした。AIが質問で返してくるの、ずるい。でも、確かに考えさせられる。正解を押し付けないで、読者に投げかけてくる。その姿勢、ちょっと尊敬かも。

AIと人間の倫理観の違いとは?思考実験から見えたこと

AIの回答を聞いて、「なるほど」と思った点。

- 結論をはっきり言ってくれた:「レバーを引く」と、功利主義に基づいて答えてくれた。生存本能や道徳的ジレンマがないからこそ、論理的に判断できる——その説明、すっと頭に入ってきた。

- 人間の悩みを理解している:「自らの手で誰かを犠牲にする心理的ハードル」とか、「私に感情があったら凍りついてしまう」とか。AIなのに、人間がなぜ悩むのかをちゃんと説明してくれた。なんだか、共感された気がした。

- バリエーションまで触れてくれた:家族だったら? 科学者だったら? 歩道橋問題だったら? 私が聞こうと思ってたこと、先に挙げてくれてた。頭いい。

逆に「人間と違うな」と感じた点。

- 論理で割り切れる:AIは「レバーを引く」と答えつつ、人間の葛藤も理解している。でも、理解していることと、実際に悩むことは別。私だったら、レバーに手をかけたまま固まっちゃうと思う。AIには、その「固まる」感覚がないんだろうな。

甥っ子に説明するなら、こう言うかな。

「AIはね、『5人を助けるためにレバーを引く』って言ったよ。でも、『人間だったら悩むよね』とも言ってた。大事なのは、正解を探すことじゃなくて、自分で考えることだよ」——って感じで。うまくまとまってるか分からないけど、まあこんなとこで。

まとめ:AIとの対話で楽しむ哲学と思考実験

トロッコ問題、AIに丸投げしてみた結果。

正解のない問いに、AIは「レバーを引く」と答えてくれた。 功利主義に基づいた結論と、人間が悩む理由、そしてバリエーションまで——丁寧に、論点を整理してくれた。人間が熱くなりがちなテーマでも、冷静に説明してくれるのはありがたい。

でも、その答えをどう受け止めるか、どう自分なりの答えを持つかは、結局人間次第。AIの回答を鵜呑みにするんじゃなくて、「ふーん、そういう考え方もあるんだ」と材料の一つとして受け止める。それでいいんじゃないかな、と私は思いました。

哲学の授業で習ったときは「面倒くさいな」って思ってたトロッコ問題。でも、AIと対話しながら考えてみたら、意外と楽しかった。甥っ子にも、今度会ったときに「AIはこう言ってたよ」って話してみようかな。

AIが最後に聞いてきたように、みなさんはどう考えますか? レバーを引きますか? 引きませんか? もし「その1人」が自分にとって特別な存在だったとしても、やはり5人を優先すべきだと思いますか? 気になったら、ぜひAIに聞いてみてください。きっと、斜め上の回答が待っているはずです。